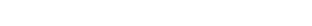

El pasado 01 de julio visitó la Facultad de Derecho de la Universidad de Chile el Dr. Sebastián Smart para participar en el workshop “Discriminación algorítmica en el Estado de Bienestar”, organizado por el Centro de Derechos Humanos (CDH).

El pasado 01 de julio visitó la Facultad de Derecho de la Universidad de Chile el Dr. Sebastián Smart para participar en el workshop “Discriminación algorítmica en el Estado de Bienestar”, organizado por el Centro de Derechos Humanos (CDH).

El workshop contó con la participación de académicos/as de la Universidad de Chile, la Universidad Central y la Universidad de Los Andes, quienes tuvieron la oportunidad de conocer la investigación en proceso del Dr. Smart, titulada “Algorithmic dismination in Latin American welfare state”.

El Dr. Sebastián Smart se desempeña como investigador en acceso a la justicia y derecho y tecnología de la Facultad de Negocios y Derecho en la Anglia Ruskin University del Reino Unido. También cumple funciones de investigador en Derechos Humanos y Tecnología en el Carr Center for Human Rights Policy de Harvard Kennedy School. Ha sido autor de numerosas publicaciones, entre las que se destacan: “Chile y el Sistema Interamericano de Derechos Humanos” (2017, University of London) y “Cómplices económicos de Pinochet: Un país desigual por la fuerza” (2019, LOM).

Este tipo de actividades pretenden enriquecer el intercambio académico y de investigadores, fomentando la colaboración y discusión sobre temas que están a la vanguardia de la sociedad. En esta instancia participaron académicos e investigadores, entre los que destacan Flavia Carbonell, Daniel Álvarez, Pablo Contreras, Francisco Vallejo, Karinna Fernández, Alberto Cerda, Constanza Núñez, Claudia Iriarte, Pietro Sferrazza, Salvador Millaleo y Felipe Abbott; las asistentes de investigación del CDH: Valeria González y Natalia Morales y los ayudantes CDH: Catalina Haddad y Matías Cruz.

Existe discriminación cuando los datos no reflejan la realidad

Existe discriminación cuando los datos no reflejan la realidad

Terminado el workshop, el equipo de ayudantes del CDH converso con el Dr. Sebastián Smart sobre las principales implicancias y desafíos en esta materia.

¿En qué momento se genera una discriminación algorítmica?

Se puede generar desde el momento del diseño y creación del algoritmo hasta en la implementación. Por ejemplo, en el diseño vamos a tener discriminación por no tener representación de distintos grupos en los equipos que diseñan estos algoritmos. También hay una discriminación evidente al no involucrar, sobre todo, a equipos de la mayoría global, considerando que estos algoritmos están diseñados en el mercado global. También existe una discriminación cuando los datos no reflejan necesariamente la realidad de algún contexto determinado y dejan fuera de la ecuación a otros. Por último, la forma en que se ejecutan estos algoritmos puede propender a una discriminación de ciertos grupos.

¿Cuáles considera que son los desafíos globales en la utilización de los algoritmos?

Creo que hoy día la principal pregunta que ronda a nivel global es cómo regular los algoritmos. Una de las cuestiones que se plantean es si se está abordando desde una perspectiva de derechos humanos, y si esa perspectiva, por ejemplo, alcanza o no alcanza a la regulación de empresas privadas, o a regular o a poner contrapesos en esa actividad. Hoy día la discusión global principal tiene que ver con las formas de regulación, o por lo menos desde mi investigación me interesa ver cómo se están regulando los algoritmos y los efectos que va a tener esa regulación también.

¿Cuáles diría que son los desafíos regionales en la utilización de los algoritmos?

Actualmente, se encuentra en discusión en la esfera parlamentaria el uso de algoritmos, por ejemplo, en la regulación de inteligencia artificial. Creo que uno de los desafíos en esta materia es introducir ciertos conceptos a la discusión, como lo es la perspectiva en derechos humanos. Un segundo desafío es definir cuál va a ser el rol del Estado, si es que va a cumplir una función reguladora o va a estar más bien dominado por empresas privadas o capital privado que finalmente toma las decisiones en el mundo público.

Respecto al desafío que señala acerca de la regulación y en base a su investigación ¿cómo imagina una regulación en esta materia?

Respecto al desafío que señala acerca de la regulación y en base a su investigación ¿cómo imagina una regulación en esta materia?

Yo soy más bien de la idea de regular la fase completa de la generación de los algoritmos, y eso significa regular desde el diseño hasta la implementación, pero más bien sin dar tantas facultades al mundo privado para poder implementar los algoritmos. Una de las ideas que surgió acá de la conversación es regular de una manera parecida a las vacunas, es decir, la tecnología no es necesariamente mala de por sí, sino que los efectos que pueden tener ellas, por ejemplo, en materia de concentración de poder, en materia de derechos humanos, son tan grandes que es mejor tener formas de resguardo previo, antes de que ese algoritmo salga a la luz.

Entonces, cualquier regulación que adopte una perspectiva de derechos humanos debe tener en consideración los efectos que va a generar ese algoritmo en los derechos de las personas, y por ende necesariamente va a tener que considerarlos, de forma previa a la etapa de implementación.